İran ve ABD arasındaki gerilime dair paylaşılan görsel içeriklerin büyük bir kısmının yapay zeka ürünü veya eski tarihli olduğu ortaya çıktı. Peki bu içeriklerin sahte olup olmadığını nasıl anlarız?

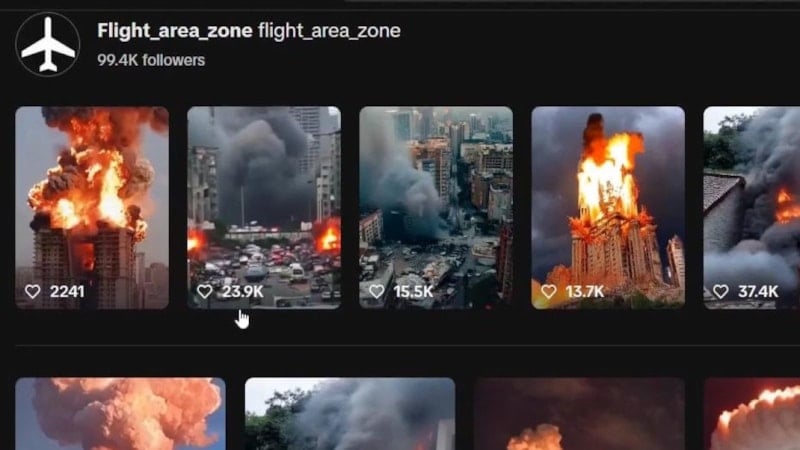

Dünya genelinde milyonlarca kullanıcısı bulunan sosyal medya platformları, ABD-İran gerilimine dair sahte içeriklerle dolup taşmaya devam ediyor.

Yapay zeka teknolojileri kullanılarak üretilen savaş görüntüleri, dijital mecralarda geniş kitlelere ulaşarak büyük bir bilgi kirliliğine ve kafa karışıklığına sebebiyet veriyor.

YAPAY ZEKA VE ESKİ GÖRÜNTÜLERLE ALGI OPERASYONU

AAP FactCheck tarafından yürütülen detaylı incelemeler, dijital içeriklerin gerçek savaş anlarını yansıtmadığını ve pek çoğunun yapay zeka aracılığıyla sıfırdan oluşturulduğunu kanıtlıyor.

Uzmanlar, güncel olaylara atfedilen birçok videonun aslında yıllar önce meydana gelmiş farklı olaylara ait olduğunu ya da yapay zeka ile üretildiğini belgeleriyle birlikte kamuoyuna sunuyor.

Maram Susli isimli bir yorumcunun Dubai'deki CIA merkezinin vurulduğu iddiasıyla paylaştığı yanan bina videosu, dezenformasyonun ulaştığı boyutları gözler önüne serdi.

Gerçekte bu görüntülerin 2015 yılında Birleşik Arap Emirlikleri'nin Şarjah kentindeki bir konut yangınına ait olduğu, uluslararası haber ajanslarının arşiv kayıtlarıyla doğrulanıyor.

DUBAİ SİMGELERİ ÜZERİNDEN YÜRÜTÜLEN SAHTE İÇERİKLER

Sosyal medya hesapları üzerinden yayılan görüntülerde; Burj Khalifa, Burj Al Arab ve Palm Jumeirah gibi simge yapıların alevler içinde kaldığı iddia ediliyor.

Yapılan ters görsel aramalar sonucunda Burj Khalifa'nın yandığını gösteren karelerin, aslında on yıl önce çekilmiş ve binayı sis bulutu içinde gösteren bir fotoğraftan ibaret olduğu anlaşılıyor.

2026 Şubat sonundaki saldırılarda bazı bölgeler hasar görmüş olsa da kentin en yüksek binası olan Burj Khalifa'nın zarar gördüğüne dair hiçbir kanıt yok.

Paylaşılan bu tarz manipülatif içerikler, bölgedeki gerçek durumun anlaşılmasını zorlaştırırken dijital platformlardaki panik havasını da körüklüyor.

HAMANEY'E AİT OLDUĞU İDDİA EDİLEN SAHTE FOTOĞRAFLAR

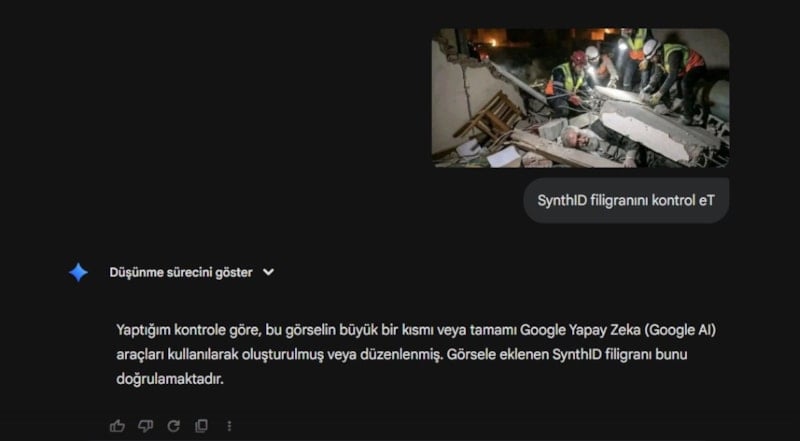

İran'ın dini lideri Ali Hamaney'in enkaz altında kaldığını gösteren fotoğrafların da tamamen dijital ortamda kurgulandığı teknik incelemelerle saptandı.

Google tarafından geliştirilen SynthID yapay zeka algılama aracı, bu görsellerin üzerinde yapay zeka üretimini doğrulayan dijital filigranlar tespit etti.

İran devlet medyasının Hamaney'in vefatına dair yaptığı resmi duyuruya rağmen, liderin naaşını veya olay anını gösteren doğrulanmış herhangi bir görsel bulunmuyor.

CENAZEYE DAİR YANILTICI VİDEO PAYLAŞIMLARI

Milyonlarca kişinin katıldığı iddia edilen bir cenaze töreni videosu, sosyal medya mecralarında İran liderine veda anları olarak servis ediliyor.

Oysa yapılan araştırmalar, bu görüntülerin 2025 yılının başlarında Lübnan'da düzenlenen farklı bir cenaze törenine ait olduğunu açıkça gösteriyor.

Videonun orijinalinde Hizbullah lideri Hasan Nasrallah için Beyrut'ta düzenlenen tören yer alırken, tabutların üzerindeki Lübnan bayrakları dikkatli gözlerden kaçmıyor.

Bu tür içerikler, kullanıcıların duygusal tepkilerini istismar ederek gerçeği saptırmak amacıyla sistemli bir şekilde dolaşıma sokuluyor.

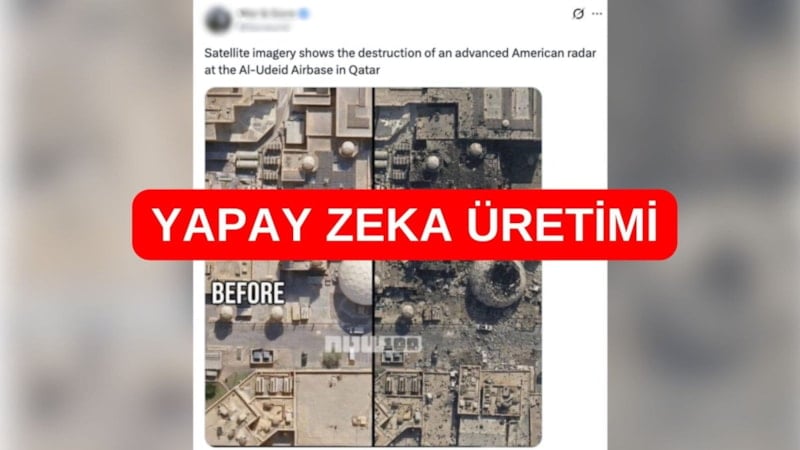

ASKERİ ÜSLERE DAİR MANİPÜLE EDİLMİŞ UYDU GÖRÜNTÜLERİ

Katar'da bulunan El Udeid Hava Üssü'ndeki ABD radarının imha edildiğini gösteren "öncesi ve sonrası" fotoğraflarının da gerçeği yansıtmadığı belirlendi.

Analizler, "öncesi" olarak sunulan görselin aslında Bahreyn'in Manama kentindeki ABD Beşinci Filo Deniz Üssü'ne ait Google Haritalar görüntüsü olduğunu kanıtladı.

"Sonrası" olarak paylaşılan ve ağır hasarı gösteren karenin ise yapay zeka tarafından orijinal görüntüye hasar efektleri eklenerek üretildiği saptandı.

Gerçek uydu verileri bölgede bazı hasarların olduğunu doğrulasa da sosyal medyada dolaşan görsellerin tamamen dijital manipülasyon ürünü olduğu teknoloji uzmanlarınca tescillendi.

SAHTE İÇERİKLER NASIL TESPİT EDİLİR

Dijital teknolojilerin hızla gelişmesiyle birlikte yapay zeka tarafından üretilen içerikler, insan gözünün ayırt edemeyeceği kadar gerçekçi bir boyuta ulaştı. Bunu yukarıdaki örneklerde de görüyoruz.

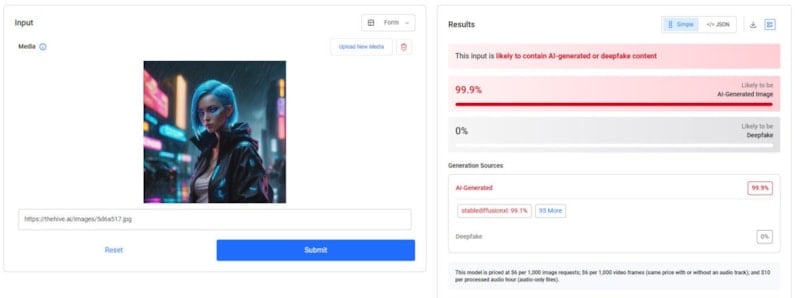

New York Times tarafından gerçekleştirilen ve 1.000'den fazla taramayı kapsayan test sonuçları, bu dedektörlerin bazı içerikleri başarıyla saptadığını ancak kesin bir hüküm vermek için henüz yeterli güveni sağlamadığını ortaya koyuyor.

TESPİT ARAÇLARININ GÜÇLÜ VE ZAYIF YANLARI

Piyasada bulunan dijital dedektörler, yapay zeka araçlarının arkasında bıraktığı dijital sinyalleri, kompozisyon hatalarını ve gizli filigranları tarayarak çalışıyor.

Yapılan testler, bu araçların basit komutlarla oluşturulmuş portre fotoğraflarını veya mükemmel ışıklandırmaya sahip sahte yüzleri saptamada oldukça başarılı olduğunu gösteriyor.

Ancak içerik karmaşıklaştıkça ve sahneler kurgusal detaylarla zenginleştikçe, birçok aracın yanılma payı ciddi oranda artış gösteriyor.

Özellikle manzara fotoğrafları veya karmaşık arka plana sahip görsellerde dedektörlerin kafası karışabiliyor.

Uzmanlar, bu araçların sonuçlarının mutlaka resmi haber raporları veya diğer görsel kanıtlarla desteklenmesi gerektiğini vurguluyor.

Tek bir aracın verdiği "gerçek" veya "yapay zeka" kararına güvenerek hareket etmek, bilgi kirliliğini daha da derinleştirme riski taşıyor.

İngiliz Vietnam Üniversitesi'nden Profesör Mike Perkins, yapay zeka tespitinde yüzde 100 başarı oranına hiçbir zaman ulaşılamayacağını savunuyor.

Yapay zeka modelleri geliştikçe, tespit araçlarının da bu gelişmeye ayak uydurmak zorunda kaldığını belirten Perkins, bu durumu bitmek bilmeyen bir "silahlanma yarışı" olarak tanımladı.

Üretici modeller daha pürüzsüz içerikler sundukça, tespit teknolojilerinin dijital ipuçlarını yakalaması her geçen gün daha da zor bir hal alıyor.

VİDEOLARIN İÇİNE GİZLENMİŞ FİLİGRANLARI ARAMAYA BAŞLAYIN

Sora iOS uygulaması üzerinden oluşturulan her video, cihaza indirildiği anda özel bir filigranla işaretleniyor. Bu işaretlemeler genellikle videonun kenarlarında hareket eden beyaz bir bulut simgesi şeklinde karşımıza çıkıyor.

İçeriklere filigran eklemek, teknoloji şirketlerinin yapay zeka üretimlerini görsel olarak ayırt etmemize yardımcı olduğu en büyük adımlardan biri.

Örneğin Google'ın Gemini Nano Banana modeli de ürettiği tüm görüntülere otomatik olarak kendi özel filigranını yerleştiriyor.

Yine de filigranların tamamen kusursuz bir güvenlik sağladığını söylemek oldukça güç. Sabit duran bir filigran basit bir kırpma işlemiyle kolayca yok edilebilirken, hareketli olanları silmek için de özel uygulamalar piyasaya sürüldü.

OpenAI CEO'su Sam Altman, bu konu hakkında toplumun herkesin sahte video üretebileceği yeni bir dünyaya uyum sağlaması gerektiğini belirtiyor.

Bu yüzden bir videonun gerçekliğini doğrulamak için sadece filigranlara değil farklı yöntemlere de güvenmemiz şart.

GÖRÜNMEYEN DİJİTAL İZLERİ YANİ META VERİLERİ KONTROL EDİN

Bir videonun sadece dış görünüşüne bakarak gerçek olup olmadığını anlamak bazen imkansız bir hal alabiliyor. Böyle durumlarda dosyanın derinliklerine inerek meta verilerini kontrol etmek harika ve bir o kadar da kolay bir çözüm yolu sunuyor.

Meta veri, bir fotoğraf veya video oluşturulduğu anda o dosyaya otomatik olarak eklenen kapsamlı bir bilgi koleksiyonunu ifade ediyor.

Bu veriler kameranın türünden çekim yerine, tarihinden yapay zeka kökenini belirten içerik kimlik bilgilerine kadar pek çok detayı barındırıyor.

OpenAI şirketinin de bir parçası olduğu İçerik Kaynağı ve Orijinalliği Koalisyonu sayesinde Sora videoları, özel meta veriler içeriyor.

SOSYAL MEDYA ETİKETLERİNE VE İÇGÜDÜLERİNİZE GÜVENİN

Instagram veya Facebook gibi Meta platformlarında geziniyorsanız, bir içeriğin yapay zeka ürünü olup olmadığını anlamak için sistemin kendi uyarılarından yardım alabilirsiniz.

Bu sistemler her zaman kusursuz çalışmasa da işaretlenmiş gönderilerdeki etiketler size içeriğin kökeni hakkında çok önemli bir ipucu verebiliyor.

Aynı şekilde TikTok ve YouTube platformları da sahte içerikleri etiketleme konusunda oldukça katı politikalara sahip.

Yine de bir şeyin yapay zeka tarafından oluşturulduğunu anlamanın en garantili yolu, içerik üreticisinin bunu dürüstçe açıklamasıyla mümkün oluyor.

Sosyal medya platformlarının çoğu artık kullanıcılara kendi gönderilerini yapay zeka üretimi olarak etiketleme imkanı sunuyor.

Açıklama kısmına eklenecek basit bir not bile dijital dünyadaki bilgi kirliliğini önleme konusunda devasa bir fayda sağlıyor.

GÖRSEL DOKULARI YAKINDAN İNCELEYİN

Yapay zeka modelleri, özellikle kaotik savaş sahnelerini üretirken bazı dokuları fazla pürüzsüz veya plastik gibi yansıtır.

Askeri araçların üzerindeki kamuflaj desenlerinde, silahların namlu uçlarında veya binaların yıkıntı detaylarında "erimiş" gibi duran, asimetrik veya birbirine giren pikseller sahteliğin en büyük habercisidir.

Tel Aviv'e atılan füzeleri gösterdiği iddia edilen aşağıdaki video, son günlerde sosyal medyada sıkça paylaşıldı. Ancak yakından bakıldığında bu görüntülerin yapay zeka ile üretildiği anlaşılıyor.

Örneğin görseldeki arabaların iç içe geçtiğini ve füze izlerinin tutarsız olduğunu görüyoruz. Üstelik bu videoyu Instagram hesabından ilk kez paylaşan kullanıcı da açıklama kısmında videonun yapay zeka üretimi olduğunu açıkça belirtiyor.

Gerçek bir patlamada duman ve ateş, rüzgarın yönüne ve ortamın fiziksel şartlarına göre kaotik ama tutarlı bir şekilde dağılır.

Yapay zeka ile üretilmiş videolarda ise alevler genellikle doğal olmayan bir simetriye sahiptir.

Duman bulutlarının havada asılı kalma süresi veya dağılma hızı gerçek dünya fiziğiyle uyuşmaz. Şarapnel parçalarının uçuş yörüngeleri genellikle eksiktir veya mantıksızdır.

ASKERİ ÜNİFORMALARA VE TABELALARA DİKKAT

Üretken yapay zeka araçları henüz harfleri ve yazıları hareketli sahnelerde kusursuz şekilde işleyemiyor.

Videodaki askerlerin üniformalarındaki peçlere, araçların üzerindeki plakalara veya sokak tabelalarına yakından bakıldığında; harflerin birbirine girdiği, hiçbir dilde karşılığı olmayan anlamsız sembollere dönüştüğü açıkça görülebilir.

SES VE GÖRÜNTÜ UYUMSUZLUĞU

Derin kurgu (deepfake) videolar genellikle görsel olarak ikna edici olsa da ses tasarımı konusunda sınıfta kalır.

Gerçek bir çatışma anında patlama sesleri, sirenler ve insan bağırışları ortamın yankı dinamiklerine göre şekillenir.

Sahte videolarda ise sesler genellikle "stüdyo ortamında kaydedilip videonun üzerine yapıştırılmış" gibi yalıtılmış ve pürüzsüz duyulur. Görüntüdeki mesafeler ile sesin şiddeti arasındaki orantısızlık kritik bir detaydır.

ARKA PLAN DETAYLARI

Odağın dışında kalan, arka planda kaçışan insanlara veya asker gruplarına dikkat edin. Yapay zeka, ana objeye odaklanırken arka plandaki figürleri genellikle deforme eder.

Fazla veya eksik uzuvlar, yüz hatları silinmiş insanlar ve doğal olmayan, tekrarlayan koşma animasyonları videonun sentetik olduğunu ele verir.

SOSYAL MEDYA DEVLERİ ALARMDA

Artan dezenformasyon dalgasına karşı sosyal medya devleri de yeni önlemler alıyor. X platformu, yapay zeka ürünü silahlı çatışma görüntülerini sentetik olduğunu belirtmeden paylaşan hesapların gelir paylaşım programından 90 gün süreyle uzaklaştırılacağını duyurdu.

Uzmanlar, şüpheli içeriklerle karşılaşıldığında tersine görsel arama yapılmasını ve bağımsız teyit platformlarının (teyit.org vb.) raporlarının takip edilmesini öneriyor.

Ayrıca, Hive AI gibi yapay zeka tespit araçlarını da kullanabilirsiniz.

Son olarak Google, kendi yapay zekaları ile üretilen içeriklere gizli bir filigran ekliyor. Google Gemini'yi açın ve fotoğrafı yükledikten sonra şunu yazın: "SynthID filigranını kontrol et." Google size bu görselin yapay zeka ile üretilip üretilmediğini söyleyecektir.